La IA pasa el test de Turing (no corran todavía)

La IA pasa el test de Turing (no corran todavía)

Un estudio revela que GPT-4.5 de OpenAI ha superado el test de Turing con una tasa de éxito del 73%, convenciendo más veces que humanos reales. Sin embargo, los expertos insisten: imitar el lenguaje humano no significa poseer inteligencia o consciencia, sino que muestra el avance de la sustituibilidad tecnológica.

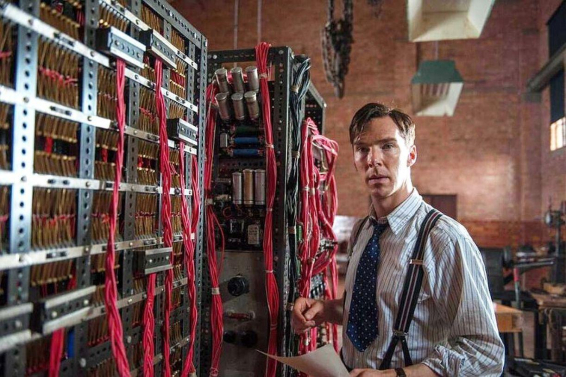

La prueba ideada por Alan Turing en 1950 —el célebre “juego de imitación”— proponía que una máquina es inteligente si puede engañar a un humano haciéndole creer que también lo es. Este test se ha convertido en un símbolo del desarrollo de la inteligencia artificial, aunque su valor es más perceptivo que científico. Ahora, un nuevo estudio realizado por Cameron R. Jones y Benjamin K. Bergen, de la Universidad de California en San Diego, demuestra que varios modelos actuales de IA pueden pasar esta prueba con éxito.

El experimento evaluó cuatro sistemas conversacionales: el histórico ELIZA, el nuevo LLaMa-3.1-405B de Meta, GPT-4o y GPT-4.5 de OpenAI. Durante cinco minutos de conversación, los interrogadores —sin saber si interactuaban con un humano o una máquina— consideraron a GPT-4.5 como humano en el 73% de los casos, superando incluso al participante humano real. LLaMa-3.1 alcanzó un 56%, ELIZA un 23% y GPT-4o solo un 21%.

Los autores del estudio aclaran que superar esta prueba no significa haber alcanzado la inteligencia general artificial. El test mide sustituibilidad: la capacidad de un sistema para reemplazar funciones sociales o económicas sin ser detectado como máquina. Por tanto, se encienden señales de alerta sobre el impacto en empleos, relaciones humanas y la confianza digital.

La historia recuerda el caso de Eugene Goostman, un chatbot que pasó el test en 2014 simulando ser un niño ucraniano de 13 años, estrategia que suavizaba sus limitaciones. Hoy, con tecnologías mucho más sofisticadas, los expertos alertan de los riesgos que conlleva no saber si interactuamos con una máquina o una persona real, incluso para investigadores expertos.

Este fenómeno puede tener profundas implicaciones éticas, sociales y económicas. La capacidad de una IA para hacerse pasar por humano sin ser detectada plantea nuevos retos en la transparencia, la regulación y la protección frente a la manipulación y desinformación.

«¿Estamos preparados para un mundo en el que no sepamos si hablamos con una persona o una máquina?»

. .

.

Este es un resumen comentado, basado en el artículo : «La IA pasa el test de Turing (no corran todavía)» de Francesc Bracero publicado en La Vanguardia el 16/04/2025.

. .