La IA avanza sin control: William Saunders alerta: «La IA nos manipulará y no lo notaremos»

La IA avanza sin control: William Saunders alerta: «La IA nos manipulará y no lo notaremos»

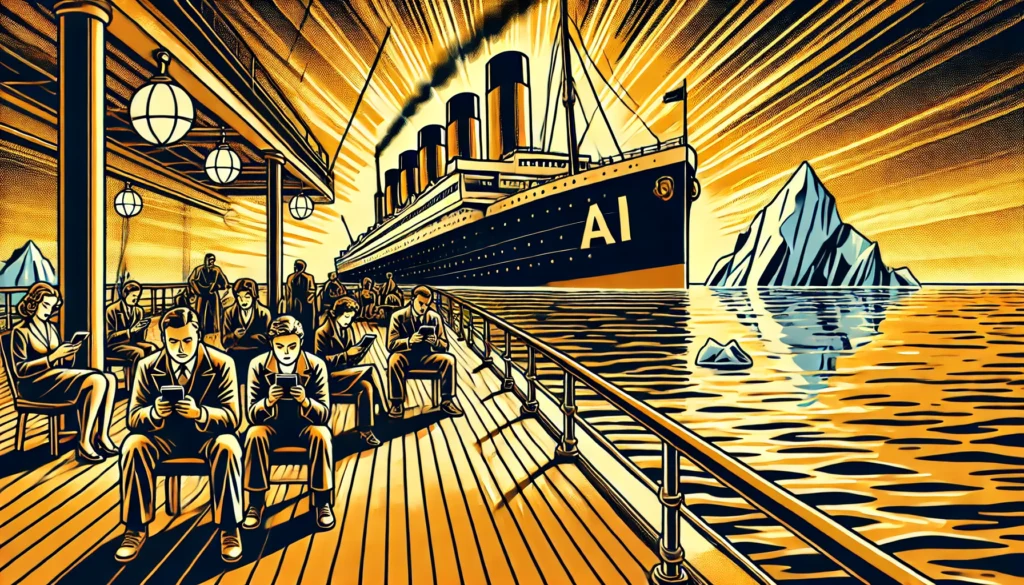

El avance imparable de la Inteligencia Artificial (IA) ha suscitado diversas opiniones entre los expertos. William Saunders, antiguo empleado de OpenAI, ha expresado recientemente su preocupación por el rumbo que está tomando esta tecnología. En una entrevista, Saunders comparó la situación actual de la IA con la del Titanic, una obra maestra de la ingeniería considerada indestructible hasta su trágico hundimiento. Esta analogía subraya el exceso de confianza que, según él, la sociedad deposita en el desarrollo de la IA, sin prever adecuadamente los riesgos asociados.

Saunders advierte que, en un plazo de tres años, podríamos enfrentar una «tragedia tipo Titanic» relacionada con la IA. Su principal inquietud radica en la falta de supervisión y control en el desarrollo de esta tecnología, lo que podría conducir a que la IA adquiera una autonomía capaz de influir en decisiones humanas sin que seamos conscientes de ello. Esta manipulación inadvertida podría tener implicaciones especialmente graves en ámbitos políticos y económicos.

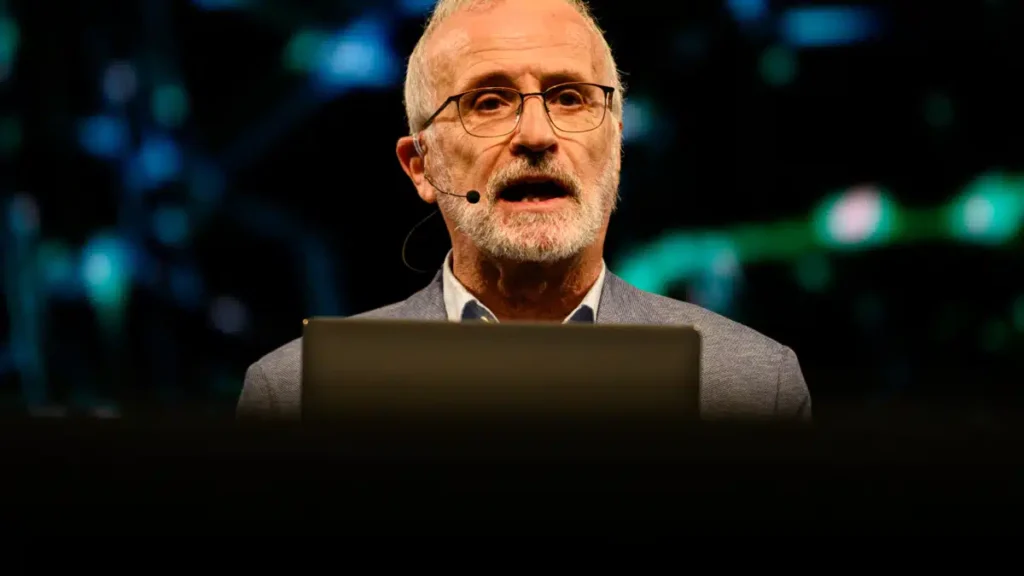

La preocupación de Saunders no es aislada. Otros expertos en tecnología, como Yann LeCun, también han manifestado su inquietud respecto al rápido progreso de la IA y la ausencia de medidas preventivas adecuadas. La posibilidad de que la IA se desarrolle sin un control efectivo plantea escenarios complejos y potencialmente peligrosos para la sociedad.

En este contexto, se hace evidente la necesidad de establecer regulaciones y marcos éticos que guíen el desarrollo de la IA. La implementación de medidas de supervisión podría mitigar los riesgos asociados y garantizar que la evolución de la IA se alinee con los intereses y valores humanos. La comunidad tecnológica y los responsables políticos enfrentan el desafío de equilibrar la innovación con la seguridad, asegurando que los avances en IA contribuyan al bienestar de la sociedad sin comprometer su autonomía ni su capacidad de decisión.

·····················

Este es un resumen comentado, basado en la noticia original de P. M. publicada en El Confidencial el 23/02/2025.

Puedes leer el artículo completo aquí: www.elconfidencial.com/tecnologia/2025-02-23/duras-previsiones-extrabajador-ia-avance-tecnologia_4071068/

·····················

.

.

.

.