El Centro Nacional de Supercomputación elimina tecnología de Huawei por poner en riesgo «los intereses de España» | Vozpópuli

El Centro Nacional de Supercomputación elimina tecnología de Huawei por poner en riesgo «los intereses de España» | Vozpópuli

El Barcelona Supercomputing Center elimina tecnología Huawei para garantizar la seguridad de datos sensibles en España

El Barcelona Supercomputing Center (BSC-CNS) ha iniciado un proceso de contratación para adaptar sus instalaciones y eliminar tecnología de Huawei, buscando crear un entorno seguro para nuevos equipos de supercomputación. Esta decisión responde a preocupaciones sobre la divulgación de datos que podrían perjudicar los intereses de España.

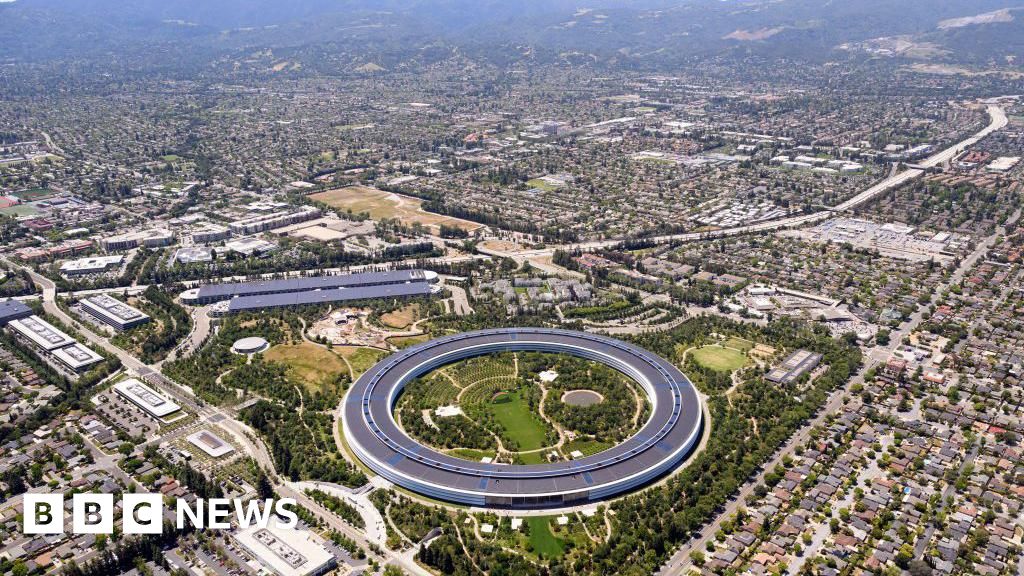

El Barcelona Supercomputing Center – Centro Nacional de Supercomputación, que depende del Ministerio de Universidades y de la Generalitat de Cataluña, ha lanzado un proceso de contratación para adaptar parte de sus instalaciones. Este proyecto tiene como objetivo acoger nuevos equipos de supercomputación en un entorno seguro y de acceso restringido, lo que incluye la eliminación de tecnología de Huawei presente en su sede. La modificación busca garantizar un nivel de seguridad que impida la difusión de datos cuya divulgación pueda perjudicar los intereses de España.

Las obras se centrarán en el sótano 1 del edificio Torre Girona, donde se adecuará el espacio del actual centro de procesos de datos. Se creará un entorno cerrado que garantice un nivel de seguridad de “difusión limitada” o equivalente, reservado para información cuya divulgación no autorizada podría perjudicar los intereses de España, aunque no comprometa directamente la seguridad nacional. Este entorno será responsabilidad exclusiva del BSC-CNS y solo podrá operar dentro de la Zona de Acceso Protegido (ZAP).

El proyecto abarca no solo la ejecución de las obras, sino también la planificación, la presentación de documentos técnicos y el cumplimiento de criterios específicos definidos en el pliego técnico. A lo largo del contrato, el adjudicatario deberá seguir las indicaciones del BSC-CNS y considerar toda la documentación adicional que este proporcione.

Entre los trabajos incluidos se destaca el desmontaje de 13 racks informáticos, que forman parte del sistema de cómputo actual. Esto incluye 9 racks del sistema Nord 3, 1 rack SL3, 1 de la marca Huawei y 2 racks AMD. Las tareas implican desconectar los sistemas eléctricos, hidráulicos y de datos, retirar las conexiones de fibra óptica y Ethernet, y embalar cuidadosamente los equipos. Todo el material será transportado desde Barcelona a un almacén ubicado en Dazango de Arriba (Madrid), donde permanecerá almacenado durante tres meses.

La polémica surgió en julio, cuando España renovó un contrato con Huawei por valor de 12,3 millones de euros para que sus servidores OceanStor 6800V gestionen el almacenamiento de las comunicaciones interceptadas por SITEL. Este sistema, utilizado por las fuerzas de seguridad bajo la jurisdicción del Ministerio del Interior, permite realizar escuchas telefónicas autorizadas judicialmente. Tras hacerse pública esta renovación, Estados Unidos se posicionó en contra, con los republicanos Tom Cotton y Rick Crawford enviando una carta a la directora de la CIA, Tulsy Gabbard, pidiendo revisar los acuerdos bilaterales de intercambio de información de inteligencia con España.

Bruselas también ha mostrado reticencias hacia Huawei. En 2018, la Unión Europea excluyó a fabricantes chinos de concursos públicos y del despliegue de redes de telecomunicaciones, citando preocupaciones sobre el espionaje. Desde entonces, al menos 11 países del bloque han prohibido contratar a Huawei, entre ellos Alemania y Suecia. En marzo, la Comisión y el Parlamento Europeo suspendieron el acceso a las instituciones de los lobistas de Huawei tras acusaciones de soborno.

El Gobierno de Xi Jinping ha elaborado legislación que obligaría a Huawei a compartir información sensible. La empresa ha defendido la legalidad y seguridad de sus productos, insistiendo en que todos sus equipos cumplen con las leyes locales y que no tienen acceso a los datos gestionados por sus clientes.

«¿Es la eliminación de la tecnología de Huawei una solución efectiva o solo una respuesta simbólica a las presiones internacionales?»

¿QUIÉN DICE QUE LA SEGURIDAD NACIONAL NO ES UN JUEGO DE PODER?

—

Fuente: www.vozpopuli.com | Ver noticia original

Fuente: www.vozpopuli.com | URL: Ver noticia original